Nyugat-Európából figyelmeztették Magyar Pétert: Sulyok Tamás leváltása veszélyes stratégia

A radikális döntés aligha tekinthető demokratikusnak.

Egyes amerikai államok új szabályokkal kényszerítik a cégeket, hogy őszinték legyenek: ha mesterséges intelligencia válaszol a panaszunkra vagy összefoglalja a leveleinket, azt nyíltan be kell vallaniuk. A vita heves: az átláthatóság erősíti a bizalmat vagy inkább fékezi az innovációt?

Képzeljük el, milyen kellemetlen helyzetbe kerülünk (sokunkkal már elő is fordult), amikor egy ügyfélszolgálati chatbot válaszol a panaszunkra, de sokáig embernek hisszük. Csak akkor vallja be, hogy MI, ha kifejezetten rákérdezünk. Vagy egy e-mail-platform automatikusan összefoglalja egy-egy félnek írt leveleinket, méghozzá előzetes értesítés nélkül. Egy felhasználó éppen emiatt váltott szolgáltatót: zavarta, hogy az MI beavatkozik a gondolkodás szabadságába. Azaz nem akarta, hogy egy személytelen, idegen algoritmus döntse el, mi a lényeges egy-egy személyes elektronikus üzenetben. Ez jól mutatja a tétet: az átláthatóság nemcsak kényelmi kérdés, hanem a felhasználói autonómia védelméről is szól.

Fontos előrebocsátani, hogy az USA-ban nincs egységes szövetségi MI-törvény, így az államok – egyelőre legalábbis – önállóan léptek. Ez azonban mozaikszerű rendszert hoz létre, amelyben a vállalatoknak államonként kell alkalmazkodniuk – ami növeli a költségeket. Az MI-szabályozás terén Utah volt az úttörő: 2024 májusától kötelező jelezni, ha generatív MI-t használnak a fogyasztói interakciókban.

Különösen szigorú az MI-szabályozás az egészségügyben, ahol már a kapcsolatfelvétel elején egyértelműen kell jelölni, hogy a beteg emberrel beszél-e.

A törvény hangsúlyozza: az MI hibáiért az azt üzemeltető cég, intézmény a felelős. Idén ugyanakkor finomhangolták a szabályokat, szűkítve a kötelező jelölést például a mentális egészségi chatbotoknál.

Kalifornia állam viszont még tovább ment: 2019 óta létezik ugyan a chatbotjelölési előírás, de 2025 októberében aláírták az SB 243-as számú szabályozást, amely az „embernek tűnő” chatbotokra fókuszál. Az AB 2013 rendelet közben a generatív MI-fejlesztőktől átláthatóságot követel, mégpedig azokról az adatokról, amikkel a tanításuk történt. Sőt, a rendőrségnek is jeleznie kell, ha MI segíti az intézkedésekkel kapcsolatos jelentések megfogalmazását – ez meglehetősen egyedi lépés a közhatalmi átláthatóság felé.

Más amerikai államok sem tétlenkednek. Colorado átfogó szabályozást tervez jövőre a magas kockázatúnak minősített MI-rendszerekre. New York állam az algoritmusokkal segített döntéshozatal során részletes átláthatóságot ír elő, különösen a munkaerő-toborzásban. Montana és Arkansas államok pedig az álhírekre, a deepfake-védelemre fókuszálnak.

Szövetségi szinten ugyanakkor továbbra is hiányzik a kifejezetten az MI-re fókuszáló jogi szabályozás.

A Szövetségi Hírközlési Hatóság (FTC) csupán meglévő törvényeket alkalmaz az MI-re, de dedikált keretrendszer a mai napig sincs. Így egyelőre az államok töltik ki a joghézagot. Közben pedig erősödik a vita: lassítsák szabályokkal a technológia terjedését, vagy biztosítsanak széles körű kikapcsolhatóságot az MI terén.

A támogatók szerint a jelölés az első lépés a felelős MI felé. Ha tudjuk, hogy MI-vel beszélünk, elkerülhetjük a manipulációt, így probléma esetén magánszemélyként vagy üzleti döntéshozóként is felelősségre vonhatjuk a szolgáltatókat. Egy egészségügyi chatbot hibás tanácsáért az egyes államoknál bemutatott törvények szerint a vállalat felel.

A nyílt jelölés így erősíti a bizalmat – senki sem érzi magát becsapva.

Akritikusok persze óvatosságra intenek. A kötelező jelölés visszafoghatja az innovációt: ha az emberek elfordulnak az MI-től a „vigyázz, robot” jellegű címkék miatt, a cégek kevesebbet fektetnek a fejlesztésbe. Egyes tanulmányok szerint a felhasználók 40-50 százaléka kerülné az MI-t kötelező jelölés esetén, különösen az érzékeny területeken. Ráadásul a kisvállalkozásoknak nehézkes államonként mindehhez alkalmazkodni.

A vitának tehát van gazdasági vetülete is. A McKinsey becslése szerint az MI 2030-ra 13 ezermilliárd dollárral növelheti a globális GDP-t. Ám,

ha a széttöredezett szabályozás fékezi a terjedést, az USA lemaradhat Kínával szemben.

Ugyanakkor a transzparencia hiánya adatvédelmi botrányokat, „elfogult” algoritmusokat szülhet, ami hosszú távon végső soron nagyobb károkat okozhat.

Európában az AI Act (ami 2024 augusztusától hatályos) egységes keretet ad, ellentétben az USA mozaikszerű szabályozásával. Az EU jelenleg a korlátozásra, a tiltásra fókuszál: tilos a társadalmi szintű online pontozás jellegű felhasználás, a rejtett manipuláció vagy közterületi, valós idejű biometrikus azonosítás, például az arcképfelismerés révén. Eközben az EU-s transzparencia már most kötelező: chatbotoknál jelezni kell, ha nem emberrel kerül kapcsolatba a felhasználó, a deepfake tartalmaknál pedig egyértelmű feliratozás szükséges. Idén pedig az általános célú MI-modellek átláthatósági szabályai léptek életbe: dokumentálni kell a tanító adatokat, kockázatokat. Ám a „feketeleves” jövőre jön, az úgynevezett magas kockázatú MI-rendszerekre szigorú szabályok érkeznek. Ide tartozik

az egészségügyi diagnosztika, a hitelbírálat, a rendvédelem és az oktatási célú vizsgáztatás.

E területeken kötelező lesz a kockázatkezelés, a minőségi adatok, a műszaki dokumentáció, a naplózás és az emberi felügyelet. A gyártóknak pedig a megfelelőségi értékelés, akár CE-jelölés is szükséges lehet. Mindez jóval szigorúbb, mint az amerikai szabályok. Az EU-ban auditálható módon kell eleget tenni a szabályoknak, az „elkövető” cég büntethetővé válik, akár a globális árbevétel 6 százaléka is kiszabható bírságként. Mindennek előnye, hogy az unió egységes piacot alkot, az Amerikaihoz képest jóval kevésbé töredezett innovációs tér jön létre. Hátrány viszont a lassabb innováció, különösen az MI-startupoknál. Az EU számára tehát a biztonság előbbre való, míg az USA ezúttal is az „előbb gyorsan innováljunk, majd vizsgáljuk meg, mit alkottunk, és ha kell, akkor javítsunk” megközelítés az irányadó.

Az MI-jelölést, annak átlátható fejlesztését és alkalmazását előíró törvényekre érdemes ma úgy tekinteni, mint amelyek nem annyira lassítják, hanem irányítják a fejlesztéseket. A felhasználói jog – elutasítani az MI-t – pedig látványosan erősíti a demokráciát a digitális térben.

Kapcsolódó:

További cikkeinket, elemzéseinket megtalálják a makronom.eu oldalon.

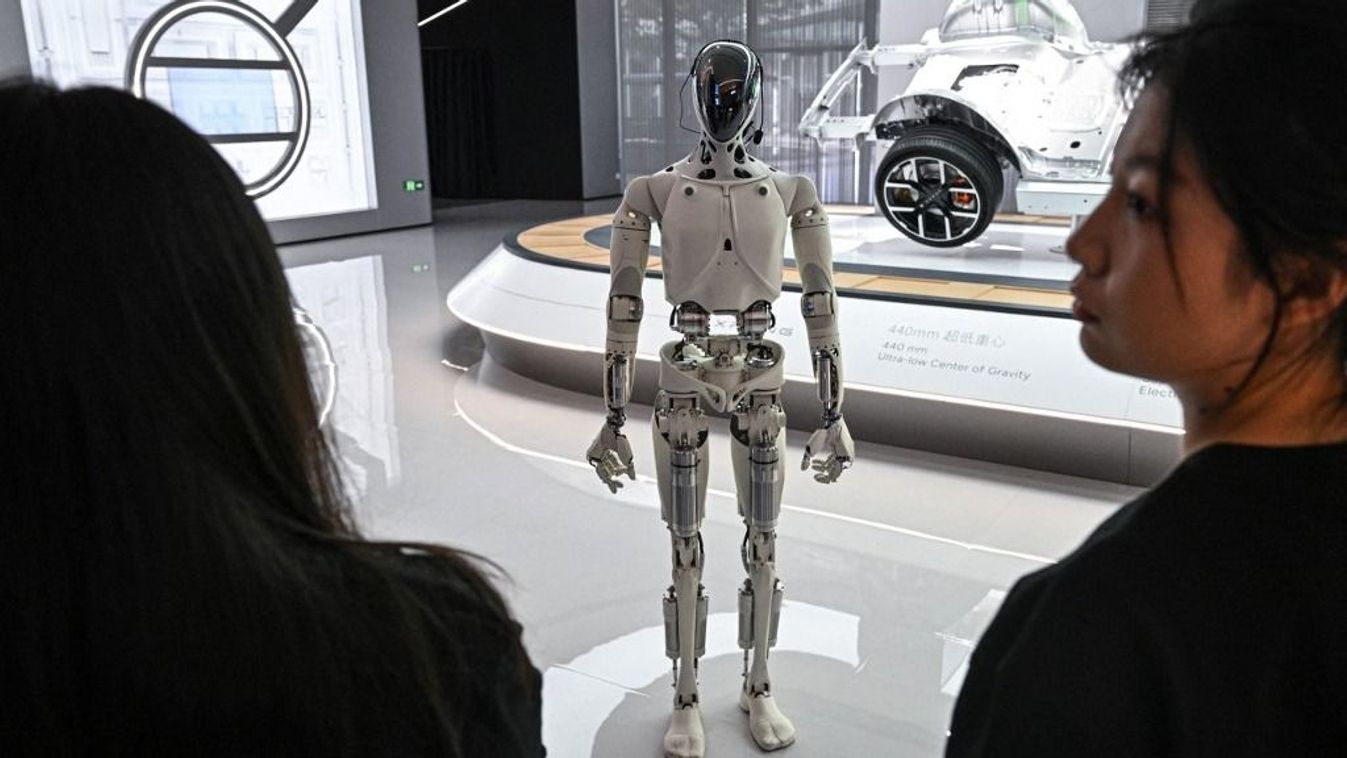

Nyitókép: Jade GAO / AFP